ინტერნეტში ასი ათასზე მეტი ქალის ყალბი შიშველი ფოტოები გავრცელდა

ფოტო: Getty

ასი ათასზე მეტი ქალი ონლაინ-თავდასხმის მსხვერპლი გახდა. როგორც BBC წერს, მათი ყალბი შიშველი ფოტოები საკომუნიკაციო აპლიკაციის, ტელეგრამის მეშვეობით გავრცელდა. ფოტოებიდან ტანსაცმელი ხელოვნური ინტელექტის მიერ იყო მოშორებული.

"ფოტოებზე, როგორც ჩანს, არასრულწლოვნებიც არიან", — ნათქვამია სადაზვერვო კომპანიის, Sensity-ის ანგარიშში.

სერვისის შემქმნელების თქმით კი, ეს "უბრალოდ გართობაა".

Sensity-ის განცხადებით, ფოტოებიდან ტანსაცმელი Deepfake ბოტის გამოყენებით მოაშორეს. Deepfake ხელოვნური ინტელექტის მიერ შექმნილი რეალისტური ფოტო, ვიდეო ან აუდიო ფაილია, რომელიც რეალურ მაგალითზეა დაფუძნებული და ინტერნეტ-მომხმარებლის შეცდომაში შეყვანას ისახავს მიზნად. გარდა პროპაგანდისტული მიზნებისა, ამ ტექნოლოგიას ხშირად იყენებენ ცნობილი ადამიანების ყალბი პორნოგრაფიული ვიდეოების შესაქმნელად.

განსხვავებით მსახიობებისა თუ პოლიტიკოსებისაგან, ჩვეულებრივი ადამიანები Deepfake-ების მსხვერპლები შედარებით იშვიათად ხდებიან. ამ მხრივ ეს შემთხვევა განსაკუთრებით საყურადღებოა.

"იმისთვის, რომ Deepfake ბოტით თქვენი შიშველი ფოტო გაავრცელონ, საკმარისია, გქონდეთ სოციალური მედიის ანგარიში ღია ფოტოებით", — ამბობს Sensity-ის აღმასრულებელი დირექტორი ჯორჯიო პატრინი.

ხელოვნური ინტელექტით აღჭურვილი ბოტი Telegram-ის გასაიდუმლოებულ არხში "ცხოვრობს" და ის რამდენიმე წუთში სრულიად უფასოდ აშორებს მომხმარებლების მიერ გაგზავნილ ფოტოებს ტანსაცმელს.

მსგავსი აპლიკაცია გასულ წელს უკვე დაიხურა, თუმცა, მისი სახეცვლილი ვერსიები ინტერნეტში ჯერაც მიმოქცევაშია.

სერვისის ადმინისტრატორი, რომელიც ცნობილია, როგორც P, ამბობს: "ეს ამბავი არ მადარდებს. ეს უბრალოდ გართობაა და ძალადობას არ ისახავს მიზნად. ამ ფოტოებით ვერავინ ვერავის დააშანტაჟებს, რადგან ხარისხი არარეალისტურია". მან ასევე დაამატა, რომ სერვისზე მომუშავე ჯგუფი ფოტოებს სწავლობს და თუ მათზე მცირეწლოვანია გამოსახული, მომხმარებელს ბლოკავს. სერვისის მომხმარებელთა 70% რუსეთიდან ან ყოფილი საბჭოთა კავშირის ქვეყნებიდანაა.

Sensity-ის ანგარიშში ასევე აღნიშნულია, რომ 2019 წლის ივლისიდან 2020 წლამდე 104 852 ქალს გაუვრცელეს ყალბი შიშველი ფოტოები.

ტელეგრამს მომხდართან დაკავშირებით ჯერ კომენტარი არ გაუკეთებია.

-

საბავშვო ევროვიზია 2026-ზე საქართველოს დავით ლომიძე წარადგენს საბავშვო ევროვიზია 2026-ზე საქართველოს დავით ლომიძე წარადგენს

-

წარმატება უფრო ახლოსაა, ვიდრე გგონია — მსოფლიოს 25 უნივერსიტეტისგან მიღებული დასტური და გზა, რომელიც არ გაჩერების ისტორიას გვიყვება წარმატება უფრო ახლოსაა, ვიდრე გგონია — მსოფლიოს 25 უნივერსიტეტისგან მიღებული დასტური და გზა, რომელიც არ გაჩერების ისტორიას გვიყვება

-

ერთი ჩვევის შეცვლამ შეიძლება დემენციის განვითარების რისკი 16%-ით შეამციროს ერთი ჩვევის შეცვლამ შეიძლება დემენციის განვითარების რისკი 16%-ით შეამციროს

გადახედვა

გადახედვა

-

შექმნეს რობოტი, რომელიც შშმ ბავშვებს ეტლიდან დამოუკიდებლად წამოდგომაში ეხმარება შექმნეს რობოტი, რომელიც შშმ ბავშვებს ეტლიდან დამოუკიდებლად წამოდგომაში ეხმარება

გადახედვა

გადახედვა

-

როგორ გაკონტროლდება სკოლებში მობილური ტელეფონების გამოყენება? როგორ გაკონტროლდება სკოლებში მობილური ტელეფონების გამოყენება?

გადახედვა

გადახედვა

-

10 ფოტო, რომლის დავიწყებაც ნახვისთანავე მოგინდება 10 ფოტო, რომლის დავიწყებაც ნახვისთანავე მოგინდება

გადახედვა

გადახედვა

-

რუსეთი სამუშაო ასაკის 12 წლამდე დაწევას განიხილავს რუსეთი სამუშაო ასაკის 12 წლამდე დაწევას განიხილავს

გადახედვა

გადახედვა

-

რიკარდ იოზვიაკი: 11 ივნისს საქართველოს უვიზო რეჟიმთან დაკავშირებით დიალოგი გაიმართება რიკარდ იოზვიაკი: 11 ივნისს საქართველოს უვიზო რეჟიმთან დაკავშირებით დიალოგი გაიმართება

გადახედვა

გადახედვა

-

7 მიზეზი თუ რატომ უნდა ისწავლო Miami Ad School-ში — შეავსე განაცხადი ნიკა გუჯეჯიანის სახელობის სასტიპენდიო პროგრამაზე 7 მიზეზი თუ რატომ უნდა ისწავლო Miami Ad School-ში — შეავსე განაცხადი ნიკა გუჯეჯიანის სახელობის სასტიპენდიო პროგრამაზე

-

Meta-მ ჭკვიან სათვალეებში ჩუმად ჩააშენა სახის ამოცნობის ტექნოლოგია Meta-მ ჭკვიან სათვალეებში ჩუმად ჩააშენა სახის ამოცნობის ტექნოლოგია

გადახედვა

გადახედვა

-

რონალდუ, მბაპე, კიმ კარდაშიანი და ლებრონ ჯეიმსი — იხილეთ Nike-ის მოკლემეტრაჟიანი ფილმი რონალდუ, მბაპე, კიმ კარდაშიანი და ლებრონ ჯეიმსი — იხილეთ Nike-ის მოკლემეტრაჟიანი ფილმი

გადახედვა

გადახედვა

-

გარემოს დაცვის საერთაშორისო დღე — კომპანია კოკა-კოლა ბოთლერს ჯორჯიამ ბათუმში დასუფთავების აქციით აღნიშნა გარემოს დაცვის საერთაშორისო დღე — კომპანია კოკა-კოლა ბოთლერს ჯორჯიამ ბათუმში დასუფთავების აქციით აღნიშნა

-

როცა ყინული ქრება — საფრთხე, რომელიც ყველას გვეხება როცა ყინული ქრება — საფრთხე, რომელიც ყველას გვეხება

გადახედვა

გადახედვა

-

ქვიზი: გადარჩებოდი თუ არა უდაბნოში? ქვიზი: გადარჩებოდი თუ არა უდაბნოში?

-

Apple ქვითრის ფოტოთი საერთო ანგარიშის გაყოფის ფუნქციას ამზადებს Apple ქვითრის ფოტოთი საერთო ანგარიშის გაყოფის ფუნქციას ამზადებს

გადახედვა

გადახედვა

-

4 ოქტომბრის საქმეზე საპროცესო შეთანხმებას კიდევ 8 ბრალდებული გააფორმებს 4 ოქტომბრის საქმეზე საპროცესო შეთანხმებას კიდევ 8 ბრალდებული გააფორმებს

გადახედვა

გადახედვა

-

მიხაილ გალუზინი: საქართველოს გარეშეც 3+3 ფორმატის პერსპექტივები სრულად ვერ განხორციელდება მიხაილ გალუზინი: საქართველოს გარეშეც 3+3 ფორმატის პერსპექტივები სრულად ვერ განხორციელდება

გადახედვა

გადახედვა

-

ქვიზი: დაასრულე ქართული გამოთქმა ქვიზი: დაასრულე ქართული გამოთქმა

-

მსოფლიოში პირველი ქარის ენერგიაზე მომუშავე წყალქვეშა მონაცემთა ცენტრი ამოქმედდა მსოფლიოში პირველი ქარის ენერგიაზე მომუშავე წყალქვეშა მონაცემთა ცენტრი ამოქმედდა

გადახედვა

გადახედვა

-

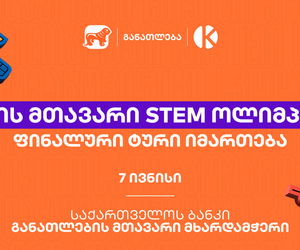

ყველაზე მასშტაბური STEM ოლიმპიადის ფინალური ტური იმართება — პროექტს საქართველოს ბანკი და კომაროვის სკოლა ახორციელებს ყველაზე მასშტაბური STEM ოლიმპიადის ფინალური ტური იმართება — პროექტს საქართველოს ბანკი და კომაროვის სკოლა ახორციელებს

-

როცა ბრედი შემოგვიერთდა, საოცრად სახალისო იყო — Friends-ის მსახიობები მოწვეულ ვარსკვლავებს იხსენებენ როცა ბრედი შემოგვიერთდა, საოცრად სახალისო იყო — Friends-ის მსახიობები მოწვეულ ვარსკვლავებს იხსენებენ

გადახედვა

გადახედვა

კომენტარები