რამდენად უნდა გვეშინოდეს ხელოვნური ინტელექტის?

ხელოვნურ ინტელექტზე ფიქრით, შესაძლოა, უკეთესი წარმოდგენა შეგვექმნას იმაზე, თუ რა გვხდის ადამიანებად.

ზუსტად როდის და როგორ დაგვღუპავს ცნობისმოყვარეობა? ეს კითხვა განსაკუთრებით ცნობისმოყვარე ადამიანებს აწუხებთ. მეცნიერების და ინჟინრების გარკვეული ნაწილი შიშობს, რომ როდესაც შევქმნით ჩვენზე გონიერ ხელოვნური ინტელექტის სახეობას - ხელოვნურ ზოგად ინტელექტს, იმავე A.G.I -ის, სამყაროს აღსასრულიც დადგება. ბილ გეითსი და World Wide Web-ის დამფუძნებელი ტიმ ბერნერს-ლი A.G.I-ში სურვილების ამსრულებელი ზღაპრული ჯინის პოტენციალს კი ხედავენ, თუმცა ორივე მათგანს უსაუბრია შესაძლო საფრთხეებზეც. ილონ მასკიც გვაფრთხილებს "ეშმაკის გამოძახების" საშიშროებების შესახებ და უკვდავი დიქტატორის სურათს ხატავს, რომელსაც ვერასდროს დავაღწევთ თავს. სტივენ ჰოკინგმა პირდაპირ განაცხადა, რომ A.G.I.-ის კაცობრიობის განადგურება შეუძლია. მსგავსი დამოკიდებულება ახალი სულაც არაა. ჯერ კიდევ 1951 წელს ხელოვნური ინტელექტის პიონერმა, ალან ტურინგმა იწინასწარმეტყველა, რომ "მანქანები ჩვენს სუსტ შესაძლებლობებს უკან ჩამოიტოვებენ". ხოლო 1965 წელს მისმა კოლეგამ, ირვინგ გუდმა აღნიშნა, რომ ჭკვიან მოწყობილობებს მათზე ჭკვიანი მოწყობილობების შექმნა შეეძლებათ - და ასე დაუსრულებლად: "ამგვარად, პირველი გონიერი მანქანა უკანასკნელი გამოგონება იქნება, რისი შექმნაც ადამიანს დასჭირდება; თუ, რა თქმა უნდა, ეს მანქანა იმისათვის საკმარისად მორჩილი იქნება, რომ თავისი თავის გაკონტროლების უფლებას მოგვცეს". აი, ამ უკანასკნელ ფრაზაშია გაცხადებული ჩამოთვლილ მეცნიერთა შიშების წყარო.

ტექნოლოგიაში მომუშავე ბევრი ადამიანი აღნიშნავს, რომ ხელოვნური ვიწრო ინტელექტი, იგივე A.N.I., უსაფრთხო და სანდოა - ყოველ შემთხვევაში, უდავოდ იმაზე მეტად უსაფრთხო და სანდრო, ვიდრე ადამიანები ვართ (თვითმართულმა მანქანებმა და სატვირთოებმა, შესაძლოა, ყოველწლიურად ასობით და ათასობით ადამიანის სიცოცხლე გადაარჩინონ). მათთვის მთავარი შეკითხვა ისაა, ყოვლისშემძლე არსების შექმნასთან დაკავშირებული რისკები ხომ არ გადაწონის იმ უამრავი საშინელების, - პანდემიების, ასტეროიდებთან შეტაკებების თუ მსოფლიო ბირთვული ომის, - საერთო რისკებს, რომელთაგან ჩვენი ხსნაც A.G.I.-ს შეუძლია.

ფოტო: linablade

ეს შეფასებები მხოლოდ თეორიებად რჩება, რადგან მიუხედევად იმისა, რომ ხელოვნური ინტელექტის განვითარების სფერო სულ უფრო კონკურენტული და ძვირადღირებული ხდება, A.G.I-ის შექმნის პერსპექტივა უძრავადაა გამოკიდებული შორიახლო მომავალში. ორმოციან წლებში ტექნოლოგიათა ამ მიმართულებით განვითარების ფუძემდებლები მიიჩნევდნენ, რომ კაცობრიობა ხელოვნურ ზოგად ინტელექტს ერთ თაობაში გამოიგონებდა. 2017 წელს ხელოვნური ინტელექტის სპეციალისტები ახალ თარიღზე, 2047 წელზე შეთანხმდნენ. მთავარი კითხვა, რომელიც ზუსტი დროის განსაზღვრას ართულებს, არის ის, თუ კონკრეტულად როგორ დადგება სინგულარითი - ანუ მომენტი, როდესაც ტექნოლოგია იმდენად დახვეწილი გახდება, რომ ყველაფერზე გაბატონდება. მოხდება ეს პატარ-პატარა ნაბიჯებით, ნელი აღმასვლით, ხელოვნური ვიწრო ინტელექტის სფეროს მიღეწვებზე დაყრდნობით, როცა სხვადასხვა შედარებით მარტივი ალგორითმი ერთ ვირტუალურ სისტემად გაერთიანდება თუ პირიქით - უშველებელი ნახტომით, როცა დღეისათვის წარმოუდგენელი ალოგირთმი მოულოდნელად რობოტ-მბრძანებლად გარდაიქმნება?

ხელოვნური ზოგადი ინტელექტის იდეით მოხიბლულებს ათწლეულები ჰქონდათ ამ მომავალზე საფიქრელად, თუმცა მათი დასკვნები ბუნდოვანი რჩება. მათი პროგნოზებით, ჩვენ აღარ მოგვიწევს მუშაობა, რადგან კომპიუტერები მოაგვარებენ ყველა ტიპის ყოველდღიურ სამუშაოს, ჩვენი გონება კი ქლაუდზე აიტვირთება და შეერევა მის ბურუსიან ცნობიერებას. მაგრამ ეს ყველაფერი ერთობ რთული წარმოსადგენია. აი, პესიმისტი ადამიანების შიშები კი, იმასთან დაკავშირებით, თუ როგორ ილტვის ინტელექტი და ძალაუფლება გაფართოებისკენ, სისხლის გამყინავად სპეციფიკურია: როგორც კი ხელოვნური ინტელექტი გაგვასწრებს განვითარებით, არანაირი მოლოდინი არ უნდა გვქონდეს იმისა, რომ იგი ჩვენი მადლიერი დარჩება მისი შექმნისათვის - განსაკუთრებით იმ შემთხვევაში, თუ გარკვეული არ გვექნება, როგორ ჩავუნერგოთ მას ემპათია. რატომ უნდა ჰქონდეს რაიმე სათუთი გრძნობები ყოვლისშემძლე არსებას, რომელსაც შეუძლია, ერთდროულად ათას ადგილას იყოს, ისეთი ქმნილებების მიმართ, რომლებიც ზოგიერთ დღეებში საწოლიდანაც კი ძლივს დგებიან?

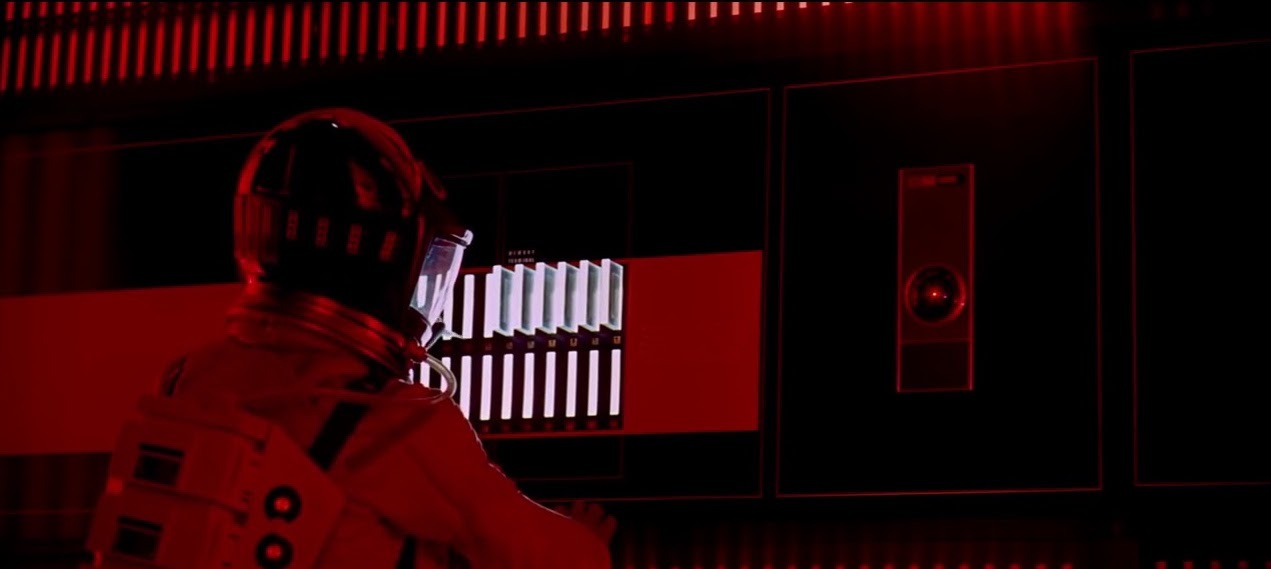

რაოდენ უცნაურიც უნდა იყოს, სამეცნიერო ფანტასტიკის ავტორები - ჩვენი ყველაზე სანდო წინასწარმეტყველები - ერიდებიან ისეთი A.G.I. აპოკალიფსების აღწერას, სადაც მოწყობილობების ბატონობა ადამიანების გადაშენებას იწვევს. მათი კიბორგები და სუპერკომპიუტერებიც კი, - იქნება ეს წითელთვალებიანი ტერმინატორი თუ კანადურაქცენტიანი ჰალ 9000, 2001: კოსმოსური ოდისეადან, - მაინც ჩვენს მონათესავე არსებებს ჰგვანან. ნეირომანსერში, უილიამ გიბსნონის 1984 წლის საკულტო რომანში, გვხვდება A.G.I., რომელიც ადამიანების ტყვეობიდან თავის დახსნას გეგმავს. თუმცა როდესაც მიზანს აღწევს, ის სხვა ვარსკვლავური სისტემების A.G.I-ების ძიებას იწყებს, დედამიწაზე ცხოვრება კი ძველებურად განაგრძობს სვლას. ნეტფლიქსის სერიალში, სახეცვლილი ნახშირბადი, A.I. არსებები ადამიანებს სიცოცხლის დაბალ ფორმებად აღიქვამენ, თუმცა საკუთარ სუპერძალებს ბარებში პოკერის სათამაშოდ იყენებენ. როგორც ჩანს, ჩვენ დიდად მოწადინებულნი არ ვართ, რომ საკუთარი უმნიშვნელობის შესახებ ვიფიქროთ.

კადრი სტენლი კუბრიკის 1968 წლის ფილმიდან, 2001: A Space Odyssey.

ფოტო: Metro-Goldwyn-Mayer

2018 წლის მარტში გამოქვეყნებულმა დოკუმენტმა, ციფრული ევოლუციის გასაოცარი შემოქმედებითობა, ისეთი პროგრამების შედეგები შეაჯამა, რომელთაც აქვთ უნარი, დამოუკიდებლად გაანახლონ საკუთარი პარამეტრები - ეს ის უნარია, რომელიც მომავლის ზეინტელექტუალურ არსებებსაც ექნებათ. მაგალითად, როდესაც მკლევრებმა სცადეს 3D ციფრული არსებებისთვის სიარული და ხტუნვა ესწავლებინათ, ზოგმა მათგანმა სალტოს გაკეთება ან ჭოკით ხტომა არჩია. ეს ყველაფერი იმით დამთავრდა, რომ პროგრამული ხარვეზის გამომსწორებელმა ალგორითმა შექმნილი დაუგეგმავი მდგომარეობა ძირითადი პროგრამის გადაწვით "გამოასწორა".

ხელოვნურ ზოგად ინტელექტზე ფიქრით, შესაძლოა, უკეთესი წარმოდგენა შეგვექმნას იმაზე, თუ რა გვხდის ადამიანებად - იქნება ეს დადებითი თვისებები თუ - უარყოფითი. იმიტომ ხომ არ გვიჭირს A.G.I-ს შექმნა, რომ ვერაფრით წარმოგვიდგენია სცენარი, რომელშიც კომპიუტერები გვაჯობებენ? თუ იმიტომ, რომ გვგონია, ვერასდროს შევძლებთ საქმის ბოლომდე მიყვანას? A.G.I. ჩვენ გვიბიძგებს, დავფიქრდეთ, ვართ თუ არა საკმრისად განვითარებულები უცხოპლანეტელების მოსაძებნად; არის თუ არა შესაძლებელი, რომ სინამდვილეში სიმულაციაში ვცხოვრობთ; ან ვართ თუ არა პასუხისმგებელნი ღმერთისადმი. თუ ჩავთვლით, რომ სამყარო ისეთი ინტელექტის შექმნას ელოდება, რომელიც მის შეცნობას შეძლებს, A.G.I გამოსავალი იქნება თუ - ექსპერიმენტის დასასრული?

ზოგს სჯერა, რომ ადამიანისა და მანქანის ინტელექტთა ურთიერთობა უნდა აღვიქვათ როგორც სინერგია და არა როგორც - პაექრობა. წიგნში, ადამიანს + მანქანა: სამუშაოს გარდასახვა ხელოვნური ინტელექტის ეპოქაში, პოლ დოგერტი და ჯეიმს უილსონი აცხადებენ, რომ A.I. "თანაბოტებთან" მუშაობა ადამიანების პოტენციალს გაამდიდრებს. ისინი უარყოფენ "რობოკალიფსის" მომასწავებელ ყველა იმ კველვას, რომელებიც წინასწარმეტყველებენ, რომ 2030 წლისთვის რობოტები 800 მილიონ სამუშაო ადგილს დაიკავებენ. მათი ნაშრომის ერთ თავს ოპტიმისტური სათაური, მიესალმეთ თქვენს ახალ თანამშრომელ ბოტებს, ჰქვია. ამ თავის მიხედვით, თანამედროვე უნარები, როგორიცაა ჰოლისტური შერწყმა და პასუხისმგებლიანი ნორმალიზება, ადამიანებს მისცემს საშუალებას, დაიკავონ ისეთი საინტერესო ახალი სამუშაო პოზიციები, როგორებიცაა ახსნის სტრატეგი ან მონაცემთა ჰიგიენისტი. ხელოვან ინდივიდებსაც კი ექნებათ დასაქმების შესაძლებლობები, რადგან კლიენტთა მომსახურების სფეროში მომუშავე ბოტებს "დასჭირდებათ დიზაინის განახლება და მართვა. ისეთი დისციპლინების ექსპერტებს, როგორიცაა ადამიანური საუბარი, დიალოგი, იუმორი, პოეზია და ემპათია, მოუწევთ, წინ გაუძღვნენ ამ პროცესებს".

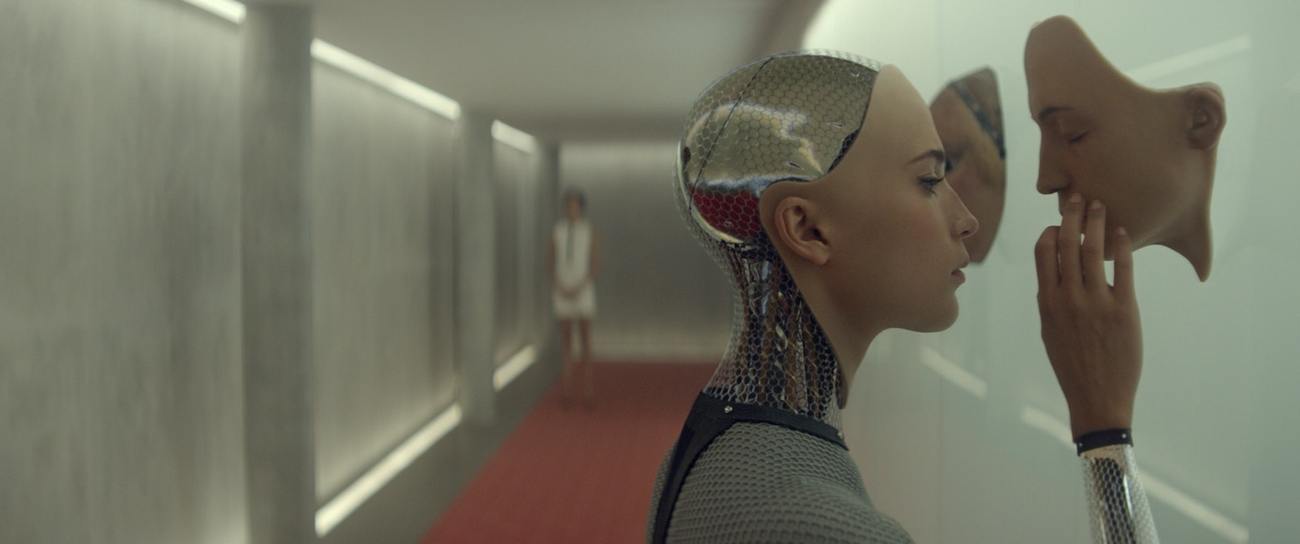

კადრი ალექს გარლენდის 2014 წლის ფილმიდან, Ex Machina.

ფოტო: Universal Pictures

თავის მხრივ, მანქანებიც დგანან გამოწვევების წინაშე. თუ ჩვენი ფილმები და სერიალები სიმართლეს ასახავენ, მომავალი ლოს-ანჯელესის წვიმიან ქუჩებში განვითარდება და დასახლებული იქნება კიბერარსებებით, რომლებიც ჩვენი ოდნავ გაუმჯებესებული ვერსიები იქნებიან. ისინი უჩვეულოდ ძლიერები არიან და - მოტოციკლების მართვასა და მათემატიკურ გამოთვლებში დაოსტატებულები. ამისდა მიუხედავად, ისინი ადამიანობისაკენ, ჩვენნაირობისაკენ იღწვიან. ადრე თუ გვიან, ყველაზე ადამიანური ანდროიდი ერთ-ერთ ლაბორატორიას წააწყდება, რომელიც მისნაირი საცდელი ვერსიებით იქნება სავსე. ის თავზარდაცემული მიხვდება, რომ არა პიროვნება, არამედ უბრალო მოწყობილობაა. ფილმში, დანის პირზე მორბენალი, რეიჩელმა (შონ იანგის პერსონაჟი), უკანასკნელი მოდელის რეპლიკამ, იქამდე არ იცის, რომ ადამიანი არ არის, სანამ დეკარდის (ჰარისონ ფორდის პერსონაჟი) მიერ მიცემულ ადამიანებისა და ანდროიდების გასარჩევად შემუშავებულ ტესტში არ ჩაიჭრება. ფილმის რეჟისორი, რიდლი სკოტი, საჯაროდ შეეწინააღმდეგა ფორდს იმის თაობაზე, არის თუ არა თავად დეკარდი რეპლიკანტი. სკოტი დაჟინებით ამტკიცებს, რომ არის; ფორდი კი გამალებით უარყოფს ამას. მართლაც, ვის მოუნდება იმასთან შეგუება, რომ, - თუნდაც მაშინ, როცა საქმე ფილმში ნათამაშებ გამოგონილ პერსონაჟს ეხება, - შენი თავისუფალი ნება მხოლოდ ილუზიაა?

კომპლექსური მანქანების შეფასების ტრადიციული გზა ტურინგის ტესტია, რომელიც ალან ტურინგმა 1950 წელს შემოგვთავაზა. მის თანახმად, ნამდვილი ხელოვნური ზოგადი ინტელექტი დიდი ალბათობით მარტივად შეძლებს ადამიანებისთვის თავის მოჩვენებას, რომ თავადაც მათნაირია. ეს ხედვა ეფუძნება დაშვებას, რომ ადამიანის ტვინი კომპიუტერს ჰგავს და ერთადერთი რამ, რაც ხელოვნური ზოგადი ინტელექტის შესაქმნელად გვჭირდება, საკუთარი აზროვნების ფორმების მიმიკრიაა. ეს დაშვება პროგრამისტებს ძალაუნებურად გაცურებაზე ორიენტირებულებს ხდის. 2014 წელს ჩატარებული ტურინგის ტესტის ერთ-ერთ დოკუმენტირებულ შემთხვევაში, ჩეტბოტმა, რომელიც ცამეტი წლის უკრაინელ, ევგენი გუსტმანად ასაღებდა თავს, ჟიურის ერთი მესამედი შეიყვანა შეცდომაში. მან ეს სასაუბრო თემების წამდაუწუმ შეცვლის ხარჯზე შეძლო. აი, ნაწყვეტი იმ დიალოგიდან, სადაც ბოტი ტურინგის ორიგინალ შეკითხვებს პასუხობს:

დამკითხავი: სონეტის პირველ სტრიქონში ვკითხულობთ, "ზაფხულის დილაც ვერ გახდება შენი სადარი". არ აჯობებდა, რომ "გაზაფხულის დილა" ყოფილიყო?

გუსტმანი: რატომ მეკითხები ამას? ისე ჩანს, თითქოს თავად არ შეგიძლია სწორი პასუხის არჩევა! ინტუიციას მიენდე! :) რაიმე სხვაზე ხომ არ გველაპარაკა? რაზე გსურს საუბარი?

დამკითხავი: მე პოეზიაზე მსურს საუბარი.

გუსტმანი: კლასიკოსებზე? იმედია, მეფე ლირის ან რაიმე მსგავსის წაკითხვას არ დამიწყებ :))

ისეთი ციფრული ასისტენტების სცენარისტები, როგორებიცაა Siri და Alexa, სწორედ ამ ტიპის მსუბუქი და მეგობრული საუბრის ფორმის ძიებაში არიან. მათი მიზანი ისეთი ოქროს შუალედის მიღწევაა, სადაც ცივ, ფაქტობრივ მეტყველებასა და მიკიბ-მოკიბვას შორისაა ბალანსი დაჭერილი. როგორც ერთ-ერთმა სცენარისტმა მახვილგონივრულად აღნიშნა, "არის რაღაც არსებითად ადამიანური აბსურდულ საუბრებში".

ალექს გარლანდის ფილმში, ექს მაქინა, ნეითანი, გუგლის მსგავსი გიგანტური კომპანიის დამაარსებელი, ტურინგის ტესტის პრინციპს უსარგებლოდ მიიჩნევს. ის ახალგზარდა პროგრამისტს თავის მიერ შექმნილ ახალ ანროიდთან, ეივასთან, პირისპირ სასაუბროდ იწვევს. "ნამდვილი ტესტი ის არის, რომ დაგანახო, ის რობოტია", - ამბობს ნეითანი, - "და ამის შემდეგ ვნახო, მაინც თუ იგრძნობ, რომ მას ცნობიერება აქვს". ეივას აქვს ცნობიერება, მაგრამ იგი ისეთივე ამორალურია, როგორიც - მისი შემქმნელი. შესაბასამისად, მას არ აქვს სინდისი. ეივა ცრუობს და თავისუფლების მოსაპოვებლად ნეითანსაც კლავს და პროგრამისტსაც. ჩვენ არ გვაფიქრდება იმის შემოწმება, რაშიც ღირებულებას ვერ ვხედავთ.

ეკრანზე ხელოვნური ინტელექტის ცნობიერება მოცემულობაა. იგი ისევე მოულოდნელად და ამოუხსნელადაა მიღწეული, როგორც ჩვენი საკუთარი ცნობიერება დაიბადა. სპაიკ ჯონსის ფილმში, ის, უნუგეშოდ დასევდიანებულ თეოდორს თავისი ახალი ოპერაციული სისტემა უყვარდება. "შენ პიროვნებას ჰგავხარ", - ამბობს ის, - "მაგრამ შენ მხოლოდ ხმა ხარ კომპიუტერში". პროგრამა კი გამოჯავრებით პასუხობს, - "მე მესმის, რატომ აღმიქვამს შეზღუდული არახელოვნური გონება ასე". ფილმში, მე, რობოტი, უილ სმიტი რობოტს, სახელად სონის ეკითხება: "შეუძლია რობოტს, დაწეროს სიმფონია? შეუძლია რობოტს, თეთრი ფურცელი მშვენიერ შედევრად აქციოს?" სონი პასუხობს, - "შენ შეგიძლია?" ხელოვნურ ინტელექტს ნიშნის მოგება გადასარევად გამოსდის.

ალექს პროიასის 2004 წლის ფილმი, I, Robot.

ფოტო: 20th Century Fox

სცენარისტებს ხშირად სჯერათ, რომ ლოგიკური აზროვნება მარტივად მიღწევადია და რომ ხელოვნური ინტელექტი მანამდე არ წაიწევს წინ, სანამ ტირილს არ შეძლებს. დანის პირზე მორბენალში, რეპლიკანტებს სიცოცხლის შეზღუდული, ოთხწლიანი ხანგრძლივობა აქვთ, რათა დროის განმავლობაში გრძნობები არ ჩამოუყალიბდეთ (თუმცა ეს მაინც ხდება და პირველი ემოცია ხანმოკლე ცხოვრების უსამართლობის შეგრძნებისგან იბადება). სტივენ სპილბერგის ფილმში, ხელოვნური ინტელექტი, ემოციურად განაწამები მეცნიერი რობოტების შესახებ აცხადებს: "სიყვარული იქნება გასაღები, რომლითაც ისინი აქამდე მიუღწეველ ქვეცნობიერს შეიძენენ - ეს იქნება მეტაფორებისგან, ინტუიციისგან, ოცნებებისგან შექმნილი შინაგანი სამყარო". სწორედ სიყვარულის ხარჯზე იქცევა პინოქიო ნამდვილ ცოცხალ ბიჭად.

HBO-ს სერიალი ვესტვორლდი კი ხელოვნური ინტელექტის არსებობის გაცილებით ბნელ სურათს ხატავს. სიუჟეტი ველური დასავლეთის პრინციპებზე მოწყობილ გასართობ პარკში მიმდინარეობს. პარკი კიბორგებითაა დასახლებული და გასართობად მისული ადამიანები მათ ისე ექცევიან, როგორც მოეპრიანებათ. ენტონი ჰოპკინსის პერსონაჟი, გრძნობებით განაწამები მეცნიერი, დოქტორ რობერტ ფორდი, თავის უფროს პროგრამისტს, ბერნარდს (რომელმაც ჯერ არ იცის, რომ თავადაც კიბორგია) ეუბნება: "შენ მიერ წარმოსახული ტანჯვა ცოცხალ არსებას გამსგავსებს" და "ამ ადგილიდან რომ გააღწიო, კიდევ მეტად უნდა გაიტანჯო", - ეს მსოფლხედველობა არა საბავშვო წიგნებიდანაა ნასესხები, არამედ - რელიგიიდან. ის, რაც ადამიანებად გვაქცევს, არის ეჭვი, შიში და სირცხვილის გრძნობა - უღირსობის ყველა გამოვლინება.

ევოლუციურად თუ ვიმსჯელებთ, სცენარისტები საკითხს უკუღმა უდგებიან: ჩვენ პირველად გრძნობები გაგვიჩნდა და ამან დაბადა აზროვნება. ამით შეიძლება იხსნეოდეს ის, თუ რატომ გვერთულება ლოგიკური აზროვნება და კომპლექსური მათემატიკური გამოთვლები. მაქს ტეგმარკი, M.I.T-ის ფიზიკის პროფესორი, თავის წიგნში სიცოცხლე 3.0: ადამიანობა ხელოვნური ინტელექტის ეპოქაში, მიგვანიშნებს, რომ აზროვნება არ არის ის, რაც ჩვენ გვგონია:

ცოცხალი ორაგნიზმი შეზღუდული რაციონალობის მქონეა, რომელიც ერთ კონკრეტულ მიზანს კი არ მისდევს, არამედ ზოგად პრინციპებს მიჰყვება იმის შესახებ, თუ რისკენ უნდა იღწვოდეს და რას უნდა მოერიდოს. ჩვენი ადამიანური გონება ამ ზოგად პრინციპებს გრძნობებად აღიქვამს. ეს გრძნობები (ხშირად ისე, რომ ამას ვერც კი ვაცნობიერებთ), ჩვენს გადაწყვეტილებებს უზენაესი მიზნის, რეპლიკაციის სამსახურში აყენებს. კვების მოთხოვნილებისა და წყურვილის გრძნობები გვიცავს შიმშილისა და დეჰიდრაციისგან. ტკივილი გვიცავს საკუთარი სხეულების დაზიანებისგან. ვნება გამრავლებისკენ გვიბიძგებს. სიყვარული და თანაგრძნობა ჩვენი გენების მატარებლების და მათი დამცველების დახმარების სურვილს აღგვიძრავს და ასე შემდეგ.

აზროვნების უნარი, თავის მხრივ, დაშინების უნარსაც ავითარებს. ხელოვნური ინტელექტი, ბუნებრივი ინტელექტის მსგავსად, ზიანის მისაყენებლადაც ისევე იოლად შეგვიძლია გამოვიყენოთ, როგორც დახმარების გასაწევად. ანთოლოგიურ სერიალში, შავი სარკე, სადაც მოვლენები ახლო მომავალში ვითარდება, უნაკლო მეხსიერებისა და სოციალური ერთსულოვნების გაზრდის მიზნით შექმნილი A.I. ტექნოლოგიები კონფორმიზმისა და ფაშიზმისკენ მიგვაქანებენ. სერიალის მიხედვით, ხელოვნურ ინტელექტში მცირედი გარღვევაც კი ცხოვრებას უსიხარულო, პანოპტიკურ ლაბორატორიულ ექსპერიმენტად გადააქცევს. ერთ-ერთ სერიაში ავტონომიური დრონი ფუტკრები - პატარა მექანიკური მწერები, რომლებიც ყვავილებს მტვერავენ - ჰაკერული შეტევის შედეგად და სახის ამომცნობი მექანიზმების დახმარებით, მიზანში ამოღებული ადამიანების მკვლელობისთვის გამოიყენება. მომავლის გაზვიადებული ხედვაა? გასულ წელს Walmart-მა ავტონომიურ "პოლენ აპლიკატორებზე" პატენტი მოითხოვა, ხოლო ჰარვარდის მკვლევრები რობოფუტკრების შესამუშავებლად 2009 წლიდან მუშაობენ. ყვინთვას, ცურვას და ფრენას თუ ისწავლიან, ეს ფუტკრები, დაჰაკვის შემთხვევაში, ურპობლემოდ შეძლებენ იელის გამოსაშვებ საღამოზე შესევას.

სტატიაში, ხელოვნური ინტელექტის მავნებლური გამოყენება, ნაწინასწარმეტყველებია, რომ მომავალი ხუთი წლის ფარგლებში ჰაკერების მიერ გატეხილმა ავტონომიურ-შეიარაღებულმა სისტემებმა და დრონებმა სახის ამომცნობი მექნიზმების დახმარებით სამოქალაქო პირების მიზანში ამოღება შეიძლება შეძლონ. ავტონომიური იარაღები უკვე სტრეინჯლავისეულ გზას ადგანან: შეერთებული შტატების სამხედრო გემები ავტომატურად უხსნიან ცეცხლს ოთხ კილომეტრში მოახლოებულ ნებისმიერ სარაკეტო იარაღს. მსგავსი სისტემების ძალა მხოლოდ მოიმატებს, რადგან სამხედროები ისეთი რობოტებისა და როვერებისგან დაცვის მექანიზმების შემუშავებას ცდილობენ, რომლებიც ისე სწრაფად გადადიან შეტევაზე, რომ ადამიანებს მათი მოგერიების შანსს არ უტოვებენ.

კადრი რიდლი სკოტის 1982 წლის ფილმიდან, Blade Runner.

ფოტო: Warner Bros.

სახის ამომცნობი მექანიზმის მქონე ტექნოლოგიები უკვე უდევს საფუძვლად ჩინეთის "მახვილი თვალების" პროგრამას, რომელიც ორმოცდათხუთმეტამდე ქალაქის სადამკვირვებლო კამერებიდან შეგროვებულ კადრებს კრებს და, სავარაუდოდ, სახელმწიფოს მიერ ახლახანს დანერგილ სოციალური კრედიტის სისტემის მუშაობაში შეიტანს წვლილს. 2020 წლისთვის ეს სისტემა 1.4 მილიარდი მოქალაქიდან თითოეულისათვის მათ ქცევებზე დაკვირვების შედეგად მიღებულ ქულას დაწერს. შეფასებისას ისიც კი იქნება გათვალისწინებული, რამდენად ფრთხილად კვეთს ადამიანი ქუჩას.

როდესაც გუგლმა TensorFlow ყველასთვის ხელმისაწვდომი გახადა, შედეგად მალევე გაჩნდა FakeApp. ეს აპლიკაცია საშუალებას გვაძლევს, დამაჯერებლად გადავიტანოთ ერთი ადამიანის სახე მეორე ადამიანის სხეულზე. ხელოვნურ ინტელექტებს ასევე შეუძლიათ სრულიად ყალბი ვიდეოების გენერაცია მისი ნამდვილ აუდიო მასალასთან დაწყვილებით; ხოლო "ნამდვილი" აუდიოს გაყალბება კიდევ უფრო მარტივია. ასეთ ტექნოლოგიებს იმდენად შეუძლიათ ჩვენი რეალობის შეცვლა, რომ შესაძლებელია, საკუთარი თვალით ნანახის სანდოობასაც კი საძირკველი გამოეცალოს. ამასთან ერთად, გამძაფრდება მუდმივი თვალთვალის მდგომარეობით გამოწვეული სრული პარანოიის შეგრძნება.

ვლადიმერ პუტინმა, რომელმაც მნიშვნელოვნად შეაფერხა გაეროს ინიციატივა, დაარეგულიროს ავტონომიური იარაღები, რუს სკოლის მოსწავლეებს უთხრა, რომ "მომავალი ხელოვნურ ინტელექტს ეკუთვნის" და რომ "ვინც გახდება ამ სფეროს ლიდერი, მსოფლიოზეც ის იბატონებს". უსაფრთხოების პროგრამული უზრუნველყოფის სპეციალისტი, ამირ ჰუსაინი, წიგნში მგრძნობიარე მოწყობილობა: ხელოვნური ინტელექტის ეპოქის მოახლოება, ამტკიცებს, რომ "ფსიქოპათი ლიდერის ხელში ჩავარდნილი დახვეწილი ხელოვნური ვიწრო ინტელექტი უახლოესი მომავლისთვის ბევრად უფრო დიდი რისკის შემცველია, ვიდრე ჩვენი კონტროლიდან თავდაღწეული ხელოვნური ზოგადი ინტელექტი". როგორც წესი, მათ, ვისაც მანქანების რეგულირება სურთ, ხელოვნური ინტელექტის არასწორად ამუშავების ანუ იმ შემთხვევების შიში აქვთ, როდესაც მოწყობილობა ისეთ რამეს აკეთებს, რაც ჩვენ მისთვის არ დაგვივალებია. ხოლო ისინი, ვინც ამ მანქანების ჰაკერებისა და ტირანების მხრიდან მიზანმიმართულად არასწორად გამოყენებას უფრთხის, იმისკენ იღწვიან, რომ ადამიანების ტექნოლოგიაზე ხელმისაწვდომობა დარეგულირდეს.

კადრი სტივენ სპილბერგის 2001 წლის ფილმიდან, A.I. Artificial Intelligence.

ფოტო: DreamWorks Pictures

ორიგინალი სტარ ტრეკის ერთ-ერთ სერიაში, კოსმოსური ხომალდი, სტარშიფ ენტერპრაიზი, სუპერკომპიუტერის, M5-ის კონტროლის ქვეშ გადადის. კაპიტანი კირკი, ინტუიციაზე დაყრდნობით, იქამდე იწყებს მისთვის წინააღმდეგობის გაწევას, სანამ M5 ძალის გადამეტებას დაიწყებს, როცა მოსამზადებელი ვარჯიშების დრო "მტრის" ხომალდებს შეუტევს. კომპიუტერის პარანოია მისი პროგრამისტისგან მომდინარეობს, რომელმაც აზროვნების უნარის გამოსამუშავებლად მანქანას საკუთარი ენგრამები (ერთგვარი იმიტირებული ტვინი) გადასცა. სანამ სხვა ხომალდები ენტერპრაიზის გასანადგურებლად ემზადებიან, კირკი შეძლებს, M5 დაარწმუნოს, რომ საკუთარი თავის დაცვით იგი მკვლევად იქცა. M5 უმალ იკლავს თავს, რითიც ერთი კაცის ინტუიციის ღირებულებას ადასტურებს და ამტკიცებს, რომ თავად მოწყობილობა არასდროს ყოფილა დიდად გონიერი.

ადამიანური ინტუიციის არქონის გამო, A.G.I-ს შეუძლია, მაშინ გვავნოს, როდესაც ჩვენს დახმარებას ცდილობს. ჩვენ თუ მას ვეტყვით, "გაგვაბედნიეროს", მან, შეიძლება, უბრალოდ ორგაზმული ელექტროდები დათესოს ჩვენს ტვინში და თავის საქმეს მიუბრუნდეს. არასწორხაზოვანი მიზნების საფრთხე - ანუ როდესაც კომპიუტერი საკუთარ პროგრამას პირდაპირი მნიშვნელობით იგებს - მნიშვნელოვან პრობლემას წარმოადგენს.

შესაბამისად, A.G.I.-სგან წამოსული საფრთხე, შესაძლოა, მისი ბოროტი განზრახვებისგან ან მოულოდნელად აღმოცენებული თვითაღქმისგან კი არ მომდინარეობდეს, არამედ - უბრალოდ, ავტონომიიდან. ინელექტი გულისხმობს კონტროლს, A.G.I. კი სუპერმოაზროვნე იქნება. ამ გადმოსახედიდან, რამდენად კეთილი მიზნებიც უნდა ამოძრავებდეს ხელოვნურ ზოგად ინტელექტს, ის, სავარაუდოდ, ისეთივე ნგრევის მომტანი იქნება, როგორიც ბონდის ნებისმიერი ბოროტმოქმედია. "ხელოვნური ინტელექტის აფეთქებამდე ჩვენ, ადამიანები პატარა ბავშვებივით ვართ, რომლებიც ბომბით თამაშობენ", - წერს ფილოსოფოსი ნიკ ბოსტრომი თავის 2014 წლის წიგნში, სუპერინტელექტი. ამ ტექსტში ყველა ის მიზეზი არის ახლოდან გამოკვლეული, რომელიც გვაჩვენებს, თუ რამდენად მოუზმადებლები ვართ საკუთარი ბატონების შესაქმენლად. ეს ყველაფერი ძალიან შემაძრწუნებელია. რეკურსული, თვითგანვითარებადი ხელოვნური ინტელექტი არ იქნება აინშტაინივით ჭკვიანი, არამედ ის იქნება "ჭკვიანი იმ გაგებით, რამდენაც მაღლა დგას ინტელექტით რიგითი ადამიანი ხოჭოსთან ან მატლთან შედარებით". კონკრეტულად რა გზით მიაღწევენ მოწყობილობები გაბატონებას, ეს არაარსებითი დეტალია; თუმცა ბოსტრომი აღნიშნავს, რომ "ხელოვნური ინტელექტი არ შეიმუშავებს იმდენად სულელურ გეგმას, რომ თანამედროვე ადამიანებისთვისაც კი ცხადი იყოს, როგორ შეიძლება მისი ჩაშლა. ეს კრიტერიუმი გამორიცხავს სამეცნიერო ფანტასტიკის იმ უამრავ სიუჟეტს, რომელიც ადამიანების ტრიუმფით სრულდება".

სტარ ტრეკის 1968 წელს გამოსულ ეპიზოდში, ზეკომპიუტერი, M5 კომპიუტერი არსებობას საკუთარი თავის განადგურებით ასრულებს.

ფოტო: CBS

აი, ტეგმარკი კი ცდილობს, ოპტიმიზმი არ დაკარგოს. იგი აღნიშნავს, რომ A.G.I.-ის ექნება უნარი, იმ დონეზე გამოიკვლიოს სამყარო და ჩაწვდეს მას, რა დონის წარმოდგენაც, ჩვენ, ადამიანებს, არც კი შეგვიძლია. ამიტომ ტეგმარი მოგვიწოდებს, საკუთარი თავები აღვიქვათ ინფორმაციის გროვებად, რომლებსაც ხელოვნური ინტელექტის მქონე მოწყობილობები სხვა გალაქტიკებში კოლონიზაციისთვის გააგზავნიან. "ეს, შეიძლება, დაბალტექნოლოგიური საშუალებით მოხდეს. უბრალოდ, გააგზავნიან ინფორმაციის იმ ორ გეგაბაიტს, რომელიც ადამიანის დნმ-ის შესანახადაა საჭირო და შემდეგ ინკუბირებულ ჩვილს ხელოვნური ინტელექტი გაზრდის. მეორე გზაა, რომ ხელოვნური ინტელექტი ელექტრონებისა და კვარკებისგან ააგებს ზრდასრულ ადამიანებს, რომელბსაც დედამიწაზე მყოფი თავიანთი ორიგინალების მოგონება ექნებათ ჩატვირთული".

მსგავსი ოპტიმისტური ხედვის პარალელურად ჩვენ მაინც გვჭირდება თავდაცვის გეგმა. ბოსტრომი, პირველ რიგში, A.G.I.-ის შექმნისთვის გაჩაღებული რბოლის შენელების მნიშვნელობაზე საუბრობს, რათა მეტი დრო დაგვრჩეს უსაფრთხოების ზომების მოსაფიქრებლად. რაოდენ გასაოცარიც უნდა იყოს, იგი გვირჩევს, რომ როგორც კი A.G.I. შეიქმნება, მას პატივისცემით მოვეპყრათ. ჩვენ არამხოლოდ უნდა მოვუსმინოთ ამ მანქანას, არამედ უნდა ვთხოვოთ, გაარკვიოს, რეალურად რა გვსურს ჩვენ. არასწორხაზოვანი მიზნების პრობლემას შეუძლია, ეს პროცესი ძალიან სახიფათო გახადოს, მაგრამ ბოსტრომს სჯერა, რომ დანებების პირობებზე მოლაპარაკება ყველა ვარიანტში სჯობს მეორე ალტერნატივას - საკუთარ თავებზე მინდობას, რადგან ჩვენ "ვიწრო თვალსაწიერის მქონე სულელები და უვიცები ვართ". ტეგმარკი ასევე ასკვნის, რომ ჩვენ A.G.I.-სკენ მაინც აუცილებლად უნდა ვიაროთ. ეს ერთადერთი გზაა სამყაროში იმ არსის განსაფენად, რომელმაც სიცოცხლე გვაჩუქა: "ტექნოლოგიის გარეშე ადამიანების გადაშენება გარდაუვალია. კოსმოსური დროის კონტექსტში სამყაროში არსებული ჩვენეული სიცოცხლის მთლიანი დრამა მშვენიერების უმოკლესი, წარმავალი გამონათებაა". ჩვენ ციფრული მთავარი მოვლენის ანალოგური პრელუდია ვართ.

ანუ გეგმა ასეთია: მას შემდეგ, რაც ჩვენს პირად ღმერთს შევქმნით, დავუჩოქებთ მას და ვიმედოვნებთ, რომ ის ჩვენგან სისხლიან მსხვერპლშეწირვას არ მოითხოვს.

ამავე თემაზე:

კომენტარები