რა ეთიკურ პრობლემებს იწვევს ხელოვნური ინტელექტი

უნდა ჰქონდეთ თუ არა რობოტებს უფლებები? როგორ დავიცვათ თავი, თუ ხელოვნური ინტელექტი კაცობრიობის განადგურებას განიზრახავს? ვაი თუ კომპიუტერები ჩვენგან მალულად უკვე გვმართავენ?

სამეცნიერო ფანტასტიკის ჟანრის ფილმები ხშირად სწორედ ამ გამოწვევებს გვისახავენ ხელოვნური ინტელექტის (AI) მთავარ ეთიკურ საფრთხეებად. სინამდვილეში, საქმე უკვე ყოველდღიურ საკითხებთან გვაქვს.

გაზაფხულზე ჩატარებული ღონისძიება DataFest Online 2021 მთლიანად ხელოვნური ინტელექტის თემას მიეძღვნა, მათ შორის, რა თქმა უნდა, AI-ის ეთიკურ გამოწვევებზეც გაკეთდა აქცენტი. ამ კუთხით რამდენიმე სპიკერის გამოსვლა ვიხილეთ და ამ სტატიაში ორი მათგანის მიერ დასმულ მთავარ აქცენტებს მიმოვიხილავთ. დავიწყოთ ორგანიზაცია AI Governance International-ის დამფუძნებელით, ანა ჩუბინიძით, რომელმაც თავის გამოსვლაში სამი ტიპის ეთიკური გამოწვევა გამოყო.

1. მონაცემთა ეთიკურობა

ნებისმიერი სახის ხელოვნური ინტელექტისთვის, იქნება ეს ავტოპილოტის რეჟიმზე მოძრავი მანქანა თუ არარსებული ადამიანების ფოტოების შემქმნელი, საარსებო წყარო არის მონაცემები.

უმარტივესი ქმედების განსახორციელებლადაც კი, AI ხელმძღვანელობს იმ მონაცემებით, რომლებიც მის მეხსიერებაში არის ჩატვირთული. მაგალითად, არარსებული ადამიანის ფოტოს შესაქმნელად, AI აანალიზებს ათასობით ადამიანის გამოსახულებას, რათა ახალი ადამიანის ფოტო რეალისტურად გამოიყურებოდეს.

მონაცემებთან დაკავშირებული ერთ-ერთი მთავარი გამოწვევა არის პირადი მონაცემების დაცვა. ამ კუთხით ნეგატიურად ცნობილია Facebook. მისი ალგორითმები ჩვენ შესახებ დიდი მოცულობის ინფორმაციას აგროვებს, რომელთა არაკანონიერ გაყიდვაშიც კომპანიას უკვე ბევრჯერ წაუყენეს ბრალი. 2018 წელს Facebook-ს 5 მილიარდი აშშ დოლარის ოდენობის ჯარიმა დაეკისრა — ყველაზე მაღალი ჯარიმა, რომელიც ოდესმე დაკისრებია კერძო კომპანიას მონაცემთა არაკანონიერი გაყიდვისთვის.

რა თქმა უნდა, ხშირ შემთხვევაში, ჩვენ თვითონ ერთი დაკლიკვით ვაძლევთ სხვადასხვა საიტს ნებართვას, გამოიყენოს ჩვენი პირადი ინფორმაცია, ისე, რომ წესებსა და პირობებს არც კი ვეცნობით.

2. ალგორითმის ეთიკურობა

ბევრს ჰგონია, თითქოს კომპიუტერები ნეიტრალურები არიან. სინამდვილეში, ეს ასე არ არის. კომპიუტერებს ვქმნით ჩვენ, ადამიანები. თითოეულ ჩვენგანს აქვს სუბიექტური აზრები, სტერეოტიპები და მცდარი წარმოდგენები. ეს ყველაფერი ავტომატურად აისახება იმ კომპიუტერულ პროგრამებზე, რომლებსაც ადამიანები წერენ.

ხელოვნური ინტელექტის არაერთ ალგორითმს უკვე დაედო ბრალი მიკერძოებულობაში, მათ შორის ხშირია გენდერული სტერეოტიპების შემთხვევები.

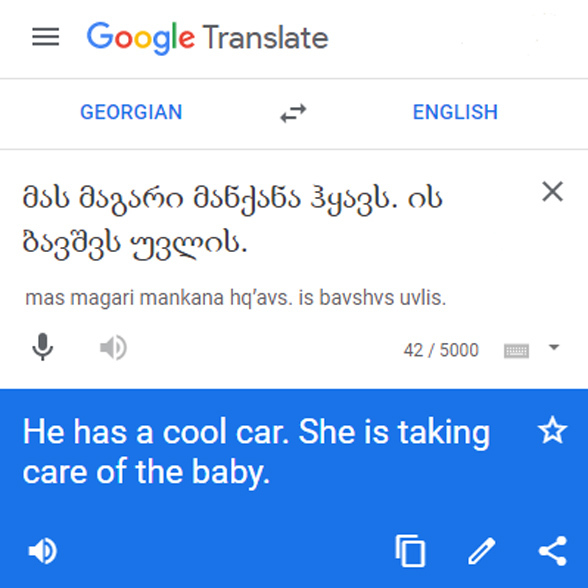

მაგალითად, Google Translate თავის თარგმანებში ასახავს ჩვენს საზოგადოებაში გავრცელებულ გენდერულ როლებს. ამის დანახვა მარტივად შეიძლება ისეთი ენიდან თარგმნის დროს, რომელშიც მხოლოდ ნეიტრალური ნაცვალსახელი გამოიყენება, როგორიცაა ქართული ენა ("ის").

ინგლისურად თარგმნის დროს, Google Translate კონტექსტს იყენებს იმისთვის, რომ შეარჩიოს, მისი აზრით, სწორი ნაცვალსახელი (He / She / It), რაც საზოგადოებაში გავრცელებულ სტერეოტიპებს იმეორებს.

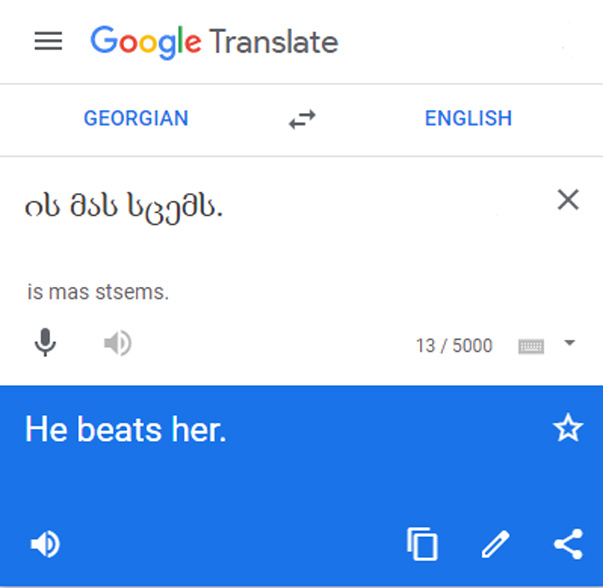

ზოგჯერ ისეც ხდება, რომ სამი მარტივი სიტყვის გადათარგმნა ჩვენს საზოგადოებაში გავრცელებულ კიდევ უფრო დამაზიანებელ პრაქტიკებზე მიუთითებს.

თუმცა რამდენად არის კონკრეტული ალგორითმის დანაშაული ის ფაქტი, რომ ის მაქსიმალური სიზუსტით გადმოსცემს ჩვენს სოციუმში გავრცელებულ მავნე პრაქტიკებს?

3. გამოყენების ეთიკურობა

ანას მიერ დასახელებული მესამე ტიპის გამოწვევა გამოყენების ეთიკურობას ეხება. ის ამბობს, რომ იმ შემთხვევაშიც, თუ ხელოვნური ინტელექტი გამართულად მუშაობს — მონაცემებიც სწორად არის შეგროვებული და ალგორითმშიც მიკერძოებულობა არ შეიმჩნევა — საბოლოოდ მას ადამიანები ვიყენებთ და ჩვენი გადასაწყვეტია, რისთვის და როგორ გამოვიყენოთ ეს "სუპერძალა".

განსაკუთრებით ხშირად გამოყენების ეთიკურობაზე საუბარი არის სამედიცინო სფეროში, ან ნებისმიერ საკითხში, რომელიც ადამიანისა თუ ცხოველის ორგანიზმზე მანიპულაციას ეხება.

მაგალითად, რამდენიმე თვის წინ, ილონ მასკის მორიგმა სტარტაპმა Neuralink განაცხადა, რომ ერთი წლის განმავლობაში შესაძლოა ადამიანზე ექსპერიმენტები დაიწყოს. აქამდე Neuralink ცდებს მაიმუნებზე ატარებდა. კერძოდ, ისინი მაიმუნის თავის ტვინში პატარა ჩიპს/ტვინის იმპლანტს ნერგავენ, რისი მეშვეობითაც ცხოველი თავისი გონებით ვიდეოთამაშებს თამაშობს.

წარმატების შემთხვევაში, ასეთ ტექნოლოგიებს შეუძლია მედიცინაში მნიშვნელოვანი წინსვლა გამოიწვიოს. მაგალითად, თავის ტვინში AI-ჩარევა დაგვეხმარებოდა ნეიროდაავადებების — ალცჰაიმერი, პარკინსონი და სხვა მქონე პაციენტების განკურნებაში. მსგავსი ტექნოლოგია უსინათლოებს დანახვის, ხოლო პარალიზებულ ადამიანებს მოწყობილობების გონებით მართვის საშუალებას მისცემდა.

თუმცა, მეორე მხრივ, მარტივია წარმოიდგინო ასეთი მძლავრი ტექნოლოგიების გამოყენების მავნე გზები, ცალკეული ადამიანების ინტერესების დასაკმაყოფილებლად. ამიტომაც ძალიან მნიშვნელოვანია არსებობდეს შესაბამისი კანონმდებლობა და მისი აღსრულების გზები, როდესაც საქმე გვაქვს აქამდე წარმოუდგენელ ტექნოლოგიურ შესაძლებლობებთან.

რა იქნება შემდეგი ეთიკური ნაბიჯი?

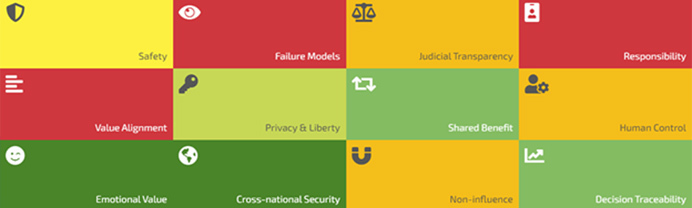

DataFest Online-ის კიდევე ერთი მომხსენებლის, Open Ethics-ის დამფუძნებელ ნიკიტა ლუკიანეცის გუნდმა ინიციატივა შეიმუშავა, რომლის მიზანი ახალი ტექნოლოგიების სამყაროში ეთიკურად გზის გაკვლევაში დახმარებაა.

Open Ethics-ში შექმნეს ონლაინ პლატფორმა, რომლის მეშვეობით AI კომპანიებს შეუძლიათ დააგენერირონ ინდივიდუალური საინფორმაციო ეტიკეტი, რომელიც შეიცავს ინფორმაციას პროდუქტის დაცვისა და ტექნიკური დეტალების შესახებ.

ეს პრინციპი დაახლოებით იგივეა, რაც საკვებ პროდუქტზე სტანდარტული ფორმით დატანილი აუცილებელი ინფორმაცია მისი შემადგენლობის, კვებითი ღირებულების, წარმოებისა და ვარგისიანობის თარიღის შესახებ. ეს გვაძლევს საშუალებას, კვებითი ტექნოლოგიების სპეციფიკური ცოდნის გარეშე, მარტივად შევადაროთ სუპერმარკეტში ხელმისაწვდომი პროდუქტები ერთმანეთს და ავირჩიოთ ჩვენთვის სასურველი.

Open Ethics-ის ეტიკეტი შეიცავს ისეთ ინფორმაციას, როგორიცაა უსაფრთხოება, იურიდიული გამჭვირვალობა, ადამიანის მიერ კონტროლი, პირადი ინფორმაციის დაცვა და სხვა. ჯამში შვიდქუალიანი სკალით 12 კრიტერიუმი ფასდება.

საბოლოოდ, უნდა გვახსოვდეს, რომ ნებისმიერი ტექნოლოგიური პროდუქტის უკან დგას ადამიანი, რომელიც მას ქმნის და მისით ოპერირებს. ამიტომ ხელოვნური ინტელექტის მოქმედებებიც დამოკიდებულია ადამიანების გადაწყვეტილებებზე, რომლებსაც ეთიკური არჩევანის გაკეთებაც უწევთ.

მართალია, ხელოვნური ინტელექტის ჩვენს ყოველდღიურ ცხოვრებაში უფრო და უფრო აქტიურ დანერგვასთან ერთად, წარმოიქმნება ახალი ეთიკური გამოწვევები. თუმცა უნდა გვახსოვდეს, რისთვის შეიქმნა ის თავდაპირველად. ამას მკაფიოდ უსვამს ხაზს ევროკავშირის AI ექსპერტების ჯგუფის განცხადება:

"ხელოვნური ინტელექტი არ არის თვითმიზანი, არამედ ის არის საშუალება იმისა, რომ ხელი შევუწყოთ ადამიანის აყვავებას და ამით გავზარდოთ ინდივიდუალური და საზოგადოებრივი კეთილდღეობა და საერთო სიკეთე, და მივიღოთ პროგრესი და ინოვაცია".

DataFest Tbilisi დეკემბერში ისევ გაიმართება. DataFest Tbilisi 2021 მეხუთე გამოშვებაა და თავს მოუყრის მონაცემებით დაინტერესებულ პროფესიონალებს მთელი მსოფლიოდან — ერთმანეთისთვის გამოცდილების გასაზიარებლად და მნიშვნელოვანი კავშირების დასამყარებლად. ტრადიციული 3 დღის ნაცვლად, DataFest Tbilisi წელს 5 დღეს გაგრძელდება და 7-11 დეკემბერს ჩატარდება. ფესტივალი გააერთიანებს ინსპირაციულ გამოსვლებს, ვორკშოპებსა და დატატონებს.

ფესტივალის ორგანიზატორია მონაცემთა ვიზუალიზაციის ორგანიზაცია ფორსეტი. ღონისძიების პარტნიორები არიან: საქართველოს ბანკი და გრანთ თორნთონი. ფესტივალის მთავარი მედიაპარტნიორია NEXT.On.ge, ხოლო მედიაპარტნიორები არიან: ფორბს ვუმენი, Marketer.ge, Entrepreneur საქართველო.

კომენტარები