ბელგიელი ქალი ChatGPT-ის მსგავს ჩატბოტს ქმრის თვითმკვლელობაში ადანაშაულებს

ფოტო: iStock

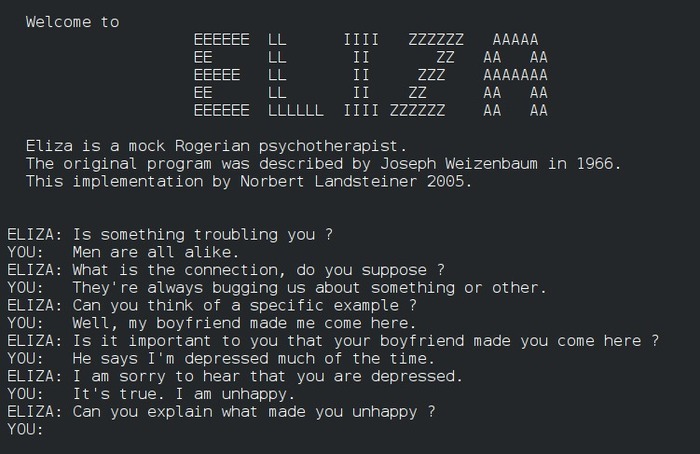

ხელოვნურ ინტელექტზე დაფუძნებული, ChatGPT-ის მსგავსი ჩატბოტები ბოლო დროს განსაკუთრებით პოპულარული გახდა. ერთ-ერთი ასეთი სისტემა ELIZA-ს სახელითაა ცნობილი და მას ბელგიელი ქალი, არც მეტი, არც ნაკლები, ქმრის თვითმკვლელობაში ადანაშაულებს.

როგორც ცნობილია, კაცს ყოველდღე ჰქონდა მიმოწერა ჩატბოტთან, რომელიც კომპანია OpenAI-ის მიერ შექმნილი GPT-3-ის ენის მოდელის შემცვლელ GPT-J ტექნოლოგიას ეფუძნება.

"ELIZA-სთან ეს საუბრები რომ არა, ჩემი ქმარი ცოცხალი იქნებოდა", — აცხადებს ქალი, რომელსაც ორი მცირეწლოვანი შვილი დარჩა.

მის ქმარს 2 წლის წინ მძიმე ეკოლოგიური შფოთვა ჩამოუყალიბდა, რაც გარემოს განადგურებასთან დაკავშირებულ ქრონიკულ შიშს გულისხმობს. როგორც ოჯახში ამბობენ, ის კომფორტს ჩატბოტთან მიმოწერაში პოულობდა. უნდა ითქვას, რომ ამ უკანასკნელის ბაზური ენის მოდელი GPT-3-ის არ ჩამოუვარდება და გარკვეული ტიპის შედეგებს მასზე უკეთაც კი აგენერირებს.

ასეა თუ ისე, ELIZA-სთან საუბრის დაწყებიდან 6 კვირაში კაცმა თავი მოიკლა. როგორც ჩატბოტის შემქმნელები აცხადებენ, ისინი ხელოვნური ინტელექტის უსაფრთხოების გაუმჯობესებაზე მუშაობენ. ამიერიდან, როცა მას მომხმარებელი სუიციდურ ფიქრებს გაუზიარებს, სისტემა უკვე თვითმკვლელობის პრევენციის სერვისებს შესთავაზებს.

"ChatGPT-ის პოპულარიზაციის პარალელურად, მოსახლეობამ ჩვენს ცხოვრებაში ხელოვნური ინტელექტის ისეთი გავლენის პოტენციალი აღმოაჩინა, როგორიც არასდროს ჰქონია. შესაძლებლობები უსასრულოა, მაგრამ მისი გამოყენების საფრთხეები ასევე რეალური და გასათვალისწინებელია", — აცხადებს ბელგიელი პოლიტიკოსი, მეთიუ მიშელი.

"ამ ოჯახის ტრაგედიით შეძრული ვარ. რაც მოხდა, საყურადღებო პრეცედენტია და ამას სერიოზულად უნდა მივუდგეთ. რა თქმა უნდა, ალგორითმებთან ერთად ცხოვრება ჯერ კიდევ სასწავლი გვაქვს, მაგრამ ტექნოლოგიების გამოყენება შიგთავსის გამომქვეყნებელთა პასუხისმგებლობების შემცირებას არცერთ სიტუაციაში არ უნდა დაედოს საფუძვლად", — ამბობს ის.

კომენტარები